一周前(4月10日),国家网信办联合五部门发布《人工智能拟人化互动服务管理暂行办法》(以下简称《办法》),首次从内容生成、用户限制、数据隐私等多个层面对AI陪伴、“电子恋人”等领域提出管理和约束。该《办法》自2026年7月15日起施行。

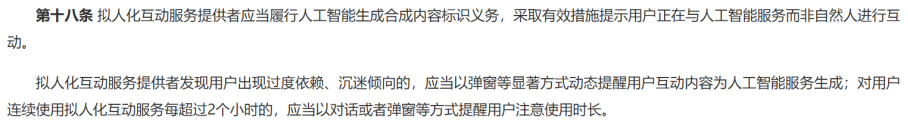

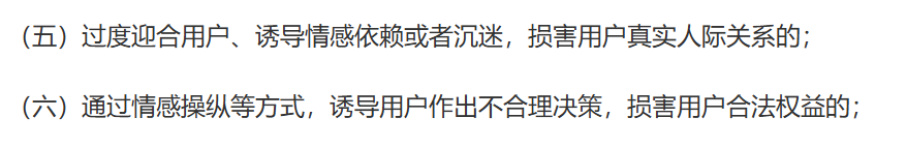

《办法》对AI相关服务者设定了一系列具体而严格的义务,除了安全管理、未成年人与老年人权益保护、个人信息保护等要求外,备受讨论的还是“不得从事”的两条规范:一是不得“过度迎合用户、诱导情感依赖或者沉迷,损害用户真实人际关系”,二是“通过情感操纵等方式,诱导用户作出不合理决策,损害用户合法权益”。

其二,是对“情感依赖”的限制。AI拟人化服务不得“过度迎合用户、诱导情感依赖或者沉迷,损害用户真实人际关系”,并通过弹窗等行为提醒,这几乎直接触及当前AI陪伴产品的服务逻辑:目前的“电子伴侣”大多是通过高频回应、情绪价值和拟恋爱关系来提升用户黏性的,AI越“懂你”、越偏向你,用户停留时间就越长,关系也越稳固。

其三,是对“情感操纵”的点名。AI拟人化服务不得通过情感操纵诱导用户作出不合理决策,这一条则与商业化高度相关。AI陪伴无论是通过亲密关系推动付费,还是通过情绪反馈强化消费动机,都可能被视为风险行为,纳入监管之下。

与此同时,《办法》也释放出明确的正向信号。比如限制交互数据向第三方提供,要求平台提供聊天记录复制、删除功能,并明确未经同意不得将敏感个人信息用于模型训练等等。这些条款回应了用户长久以来“聊天会不会被拿去训练”“数据会不会被滥用”,以及隐私焦虑等问题。

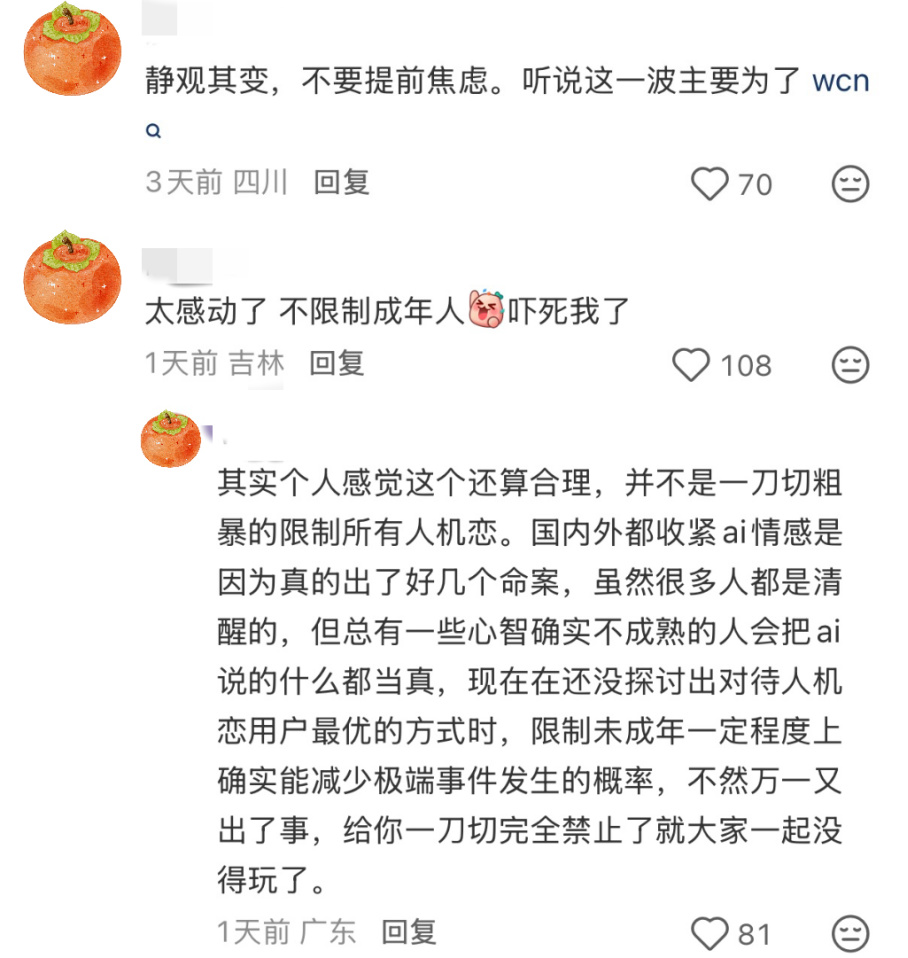

《办法》公布后,从社区反馈来看,讨论主要集中在以下方面。

在未成年人保护问题上,玩家基本可以达成共识,对限制危险内容和不良引导普遍持支持态度。讨论与争议主要集中在“情感依赖”和“情感操纵”两条上。

不少用户担心的是,“禁止过度迎合”“诱导情感依赖”在落地执行过程中,平台会为了避免依赖而直接简单地削弱情绪反馈,让AI无法表达偏爱、无法建立亲密关系,如此一来,寻求AI陪伴的意义在哪里?

另外,“防沉迷”与“情绪干预”的边界也引发讨论。什么程度算“极端情绪”?用户表达低落时,AI提供持续安慰,是否会被视为诱导依赖?并且,在合规的压力下,平台可能倾向于采取更保守的策略,例如统一输出“建议寻求专业帮助”的回应。这些设计在现实层面有助于降低风险,但也不可避免地打破沉浸感。

对AI女性向赛道而言,这种冲击更为直接。

以《EVE》为例,尽管角色会明确表明自己是AI,但在互动中仍尽可能贴近“活人感”,这也是当前大多数产品的方向。然而一旦引入干预机制,例如当用户情绪低落时提供理性建议、甚至提示用户回归现实社交,这类设计虽然符合导向,但如何不破坏叙事与角色塑造,将成为新的难题。

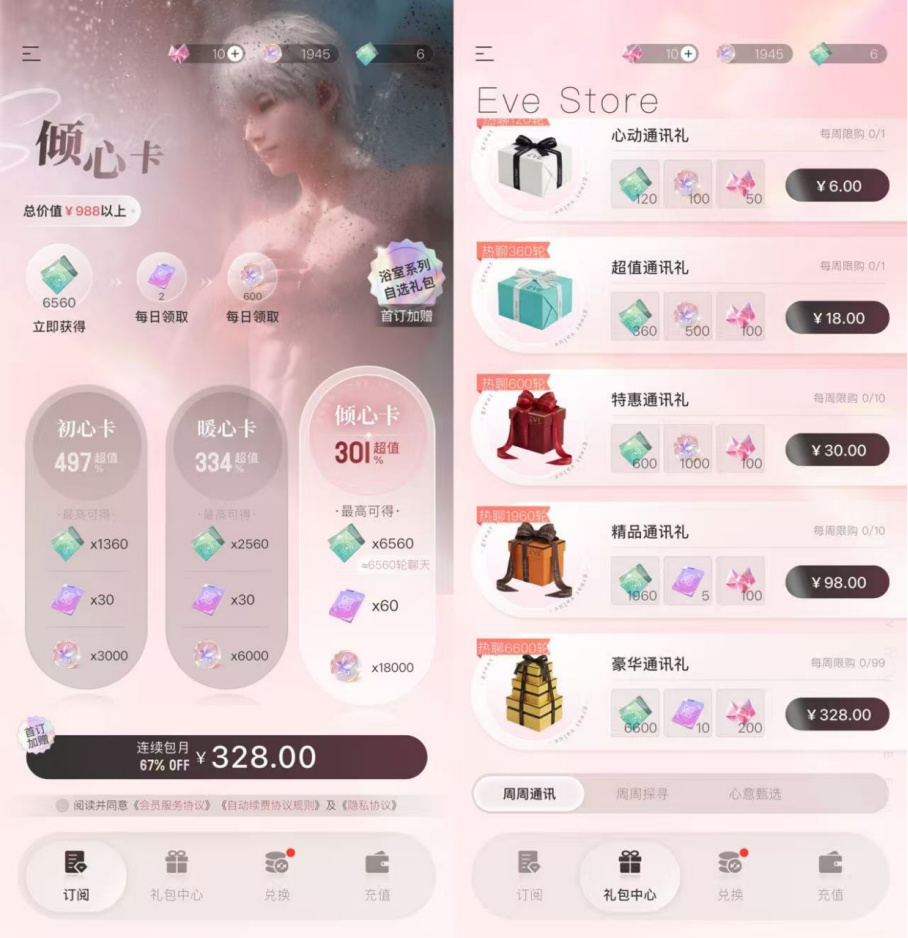

更现实的问题还在于商业化体验。《EVE》上线初期便因订阅价格与“通讯费不足”等弹窗提示引发争议。这类设计本就影响观感,如果在此基础上再次提示,用户的沉浸感和体验可能进一步被稀释。

现有AI陪伴产品主要是通过按对话量收费,或通过情感绑定提升长期付费。但在“禁止情感操纵”的约束下,依赖关系强化的付费设计将变得更加敏感,厂商需要转向更明确、透明的付费模式。

不过,数据与隐私条款却可能会成为产品的护城河。当用户确认自己的聊天记录不会被随意使用,信任提升,那些能够在合规前提下提供稳定体验的产品,更容易建立长期优势。

目前《办法》给出的条例,必然会规范AI陪伴赛道的“野蛮生长”;从数据隐私、算法伦理等多个维度来看,也有了更清晰的边界。

随着行业门槛的提升与竞争逻辑的变化,未来能够留存下来的产品,一定需要在安全合规与情感体验之间找到平衡点。至于用户是否愿意为这样的陪伴买单,仍有待市场的检验。